Интересуетесь продвинутой сертификацией VMware?

жаль, что в России пока сдавать нельзя.

Однако, должно стать можно - рано или поздно.

А пока можно ознакамливаться с разными материалами на тему, и вот, например - VCAP-DCA Live Lab Tutorial - как же этот администраторский тест с лабами выглядит.

Имхо, интересная штука.

пятница, 29 октября 2010 г.

VCAP DCA

воскресенье, 17 октября 2010 г.

vCPU count Hyper-V

Если я правильно понял, то Настоящий гипервизор™ (блин ну детский сад) технически может дать одной виртуальной машине до 64 виртуальных процессоров.

Работа процессора в Hyper-V.

UPD. По некоторым данным для гостей Windows все таки 8 vCPU максимум, для гостей Linux 32.

vforv.me

Новый (для меня) русскоязычный блог на нашу любимую тему - "V" for Virtualization, http://vforv.me.

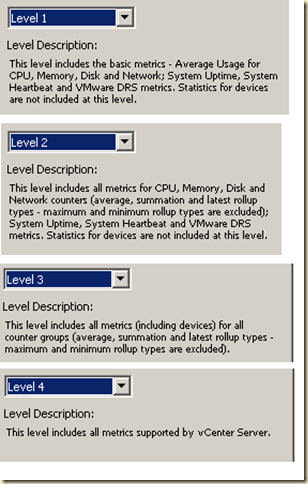

ESXi HP Customized

Как многие знают, бывает ESXi от VMware, а бывает от HP, Dell, IBM.

Вторые отличаются от первого тем, что на них присутствуют т.н. CIM Provider, интерфейсы к датчикам железа серверов.Вернее, эти провайдер есть в любом варианте и ESX и ESXi, но они более специализированные - под родное железо вендора.

На прикладном уровне вы видите результаты их работы пройдя для сервера на вкладку Hardware Status.

Как минимум HP предлагает не только собственную сборку ESXi, но и отдельно CIM Providers для установку на уже развернутый ESXi, см. ESXi 4.x Installable HP Customized ISO Image DNA.

Напомню, что для ESX вендоры предлагают стандартного агента, работающего в Service Console.

Data Migration Tool

Моя личная статистика опроса моих слушателей показывает, что применительно к vCenter Server процентов 80 админов рискуют оказаться во второй категории.

Бекап vCenter штука, с одной стороны, не очень критичная. Что происходит, если vCenter упал и совсем не встает?

В первом приближении, ничего.

Ведь виртуальные машины как работали, так и продолжают работать. Системы хранения обслуживают запросы. Сеть передает пакеты данных.

Однако, кое что нам становиться недоступно, пока vCenter мы не вернем в строй (хотя бы новый):

- Перестает централизованно собираться статистика производительности, та, что доступна на вкладке Performance.

- Не собираются события, произошедшие с инфраструктурой – вкладка Events.

- Перестанут работать alarm.

- Кластер drs перестанет работать.

- DPM, если был, перестанет работать.

- vMotion и все прочие миграции перестанут быть возможными.

- Перестанут работать интегрирующиеся с vCenter программы: Converter, Update Manager, Data Recovery.

- Если коммутаторы распределенные , изменение их настроек станет невозможным.

- Частично это касается и Cisco Nexus 1000V.

- Не получиться быстро найти и включить виртуальную машину, если она лежит на каком-то из большого числа серверов.

- Нельзя будет развертывать ВМ из шаблонов

Однако поступив так, мы теряем:

- Статистику производительности, что хранится до года – что плохо для анализа и планирования инфраструктуры.

- Теряются события, произошедшие с инфраструктурой – вкладка Events.

- Потеряются alarm, созданные нами вручную, и изменения существующих по умолчанию (настройки оповещения в первую очередь).

- Потеряются vApp и пулы ресурсов кластера drs

- Потеряются правила кластера drs

- Перестанут работать интегрирующиеся с vCenter программы: Converter, Update Manager, Data Recovery (возможно, у вас будет что-то еще). Для некоторых потребуется переустановка.

- Если коммутаторы распределенные , то конфигурация их будет потеряна - т.е. при появлении нового vCenter придется подключать к нему сервера ESX(i) и создавать новые распределенные виртуальные коммутаторы.

- Частично это касается и Cisco Nexus 1000V.

- Потеряются сертификаты.

- Если при установке vCenter мы указывали использование портов, отличных от по умолчанию – мы теряем эти значения.

А к чему это я – к тому, что если раньше резервное копирование осуществлялось средствами базы (например, для SQL Express при помощи двух кликов в Management Studio Express), то сейчас у VMware появилось родное средство – Data Migration Tool.

Это утилита командной строки из дистрибутива vCenter 4.1, хотя работает она с vCenter начиная с версии 2.5.

С ее помощью можно сохранить:

- сертификаты SSL;

- номера портов;

- данные лицензирования;

- если БД это SQL Express на той же машине, то в резервную копию будет включена и база (для SQL, Oracle и DB2 придется по прежнему БД бекапить отдельно);

- конфигурацию (не сами патчи) Update Manager, если он установлен на той же машине.

Утилита предназначена, в первую очередь, для миграции со старой на новую версию vCenter. Особенное это актуально для тех, кто будет старый vCenter на 32битной ОС обновлять до 4.1 на 64битной ОС.

Впрочем, для резервного копирования SQL Express базы она тоже может быть удобна – тем, что в бекап сохраняет не только саму базу.

UPD. Тематическая статья базы знаний - vSphere 4.1 upgrade pre-installation requirements and considerations.

Видео оттуда:

UPD. Из комментариев:

Небольшое замечание после опытов: поддерживается только Vcenter2.5 и 4.0 для сохранения конфигурации и не работает с VCenter'ом 4.1 и выше.

То же самое подтверждает саппорт VMware.

Выдает такие же ошибки:

[INFO] Checking vCenter Server version...

[INFO] vCenter Server installation version 4.1.0.12319

[INFO] vCenter Server installation version 4.1.0.12319

[ERROR] vCenter Server version not supported

вторник, 12 октября 2010 г.

the book, 2nd edition

Коллеги, в конце прошлой недели издатель сообщил, что практически весь тираж моей книги распродан.

Планируется выпуск второго тиража, и я надеюсь что это будет “издание исправленное и дополненное”.

Некоторые из вас уже сильно помогли с нахождением неточностей и опечаток, если кто-то поможет еще – буду сильно благодарен.

Информацию жду вот в этой форме или вот по этому адресу.

В первую очередь меня интересуют ошибки и неточности смысловые - на опечатки обещали натравить корректора лучшего, чем в прошлый раз.

понедельник, 11 октября 2010 г.

VMworld

суббота, 9 октября 2010 г.

vSphere licensing

Памятка.

Чем отличаются лицензии vSphere:

Дорогие – VMware vSphere Edition.

Дешевые и бесплатная - VMware vSphere for Small Business.

UPD. Из комментариев:

Вот тут более полный список

http://www.vmware.com/products/vsphere/buy/small_business_editions_comparison.html

Следует отметить один очень неприятный нюанс с Essentials Kit-ами. "Выйти" из них (добавить 4-й сервер или расширить функционал) можно только через upgrade. С Essential Kit можно перейти только на Essential Plus, со второго можно "перебежать" на Advanced или Midsize Kit.

Advanced, Midsize и Enterprise Plus Kit вещи уже "делимые", и можно туда добавлять что-то или делать какой-то Upgrade (например придется переходить с vCenter Foundation на Standard если в случае Advanced Kit захочется подключить 4-й ESX).

Понятно, что все эти upgrade очень дороги и при необходимости подключить 4-ый хост к Essential мы заплатим "по полной".

Я было подумал, как бы купить 2 Essential Plus и подключить все к общему vCenter Server, но мне сразу "дали по рукам" - это запрещено лицензионным соглашением.

P.S. Все данные по лицензированию получены не напрямую от Vmware,а от дистрибютора. Нас к нему послали из Vmware.

vCenter не стартует

Памятка.

В моем демостенде в качестве базы для vCenter используется SQL Express.

Бывает такое, что vCenter не запускается, пытаясь стартовать раньше БД – притом выставление зависимости не помогло.

В рамках овладевания PowerShell набросал скриптик для решения проблемы, скачать его:

1: #служба SQL Server 2: $sql = Get-Service -displayname *SQLEXP_VIM* 3: 4: #Служба vCenter Server 5: $vpxd = Get-Service -name vpxd 6: 7: #Служба vCenter ManagementWebServices 8: $vpxWeb = Get-Service -name vctomcat 9: 10: # Шаг 1. ждать 10 секунд => проверить статус службы SQL. Если НЕ запущена, ждать дальше. Если запущена - проверить статус службы vCenter. По хорошему надо еще ограничить число итераций, здесь этого нет.11: do {

12: echo " "

13: echo "Step 1. wait 10 seconds SQL Service to start"

14: Start-Sleep -Seconds 10 15: }16: while ($sql.Status -ine "Running" )

17: 18: # Если служба vCenter не запущена то запустить ее19: if ( $vpxd.Status -ine "Running" )

20: {21: echo " "

22: echo "Step 2. vCenter Server status =" $vpxd.Status

23: echo " "

24: echo "Starting vCenter Server"

25: Start-Service -Name vpxd26: echo "Started vCenter Server successfully!"

27: echo " "

28: } 29: 30: # Если служба веб сервера не запущена, то запустить ее.31: if ( $vpxWeb.Status -ine "Running" )

32: {33: echo "Step 3. vCenter WebServer status =" $vpxWeb.Status

34: echo " "

35: echo "Starting vCenter WebServer"

36: Start-Service -Name vctomcat37: echo "Started vCenter WebServer successfully"

38: echo " "

39: }Помещенный в автозагрузку при помощи штатного планировщика Windows 2008 скрипт, вроде как, отрабатывает как надо. Разрешено выполнение неподписанных скриптов командой

Set-ExecutionPolicy Bypass

Dmitry Gorokhov - В 2008 windows можно поставить вместо зависимости отложенную загрузку службы. С ней отлично стартует через несколько минут после старта ОС :)

воскресенье, 3 октября 2010 г.

ESX | ESXi kickstart

Недавно в официальном русскоязычном форуме VMware появилась тема Клонирование ESXi 4.

Топикастера интересовали способы и средства для снятия и разливки ESXi на уровне образа флешки, с обезличиванием.

Набежавшие завсегдатаи (в их числе и я) по существу сказать ничего не смогли, аргументируя это тем, что проще установить с нуля. А если требуется много установок – установить с файлом ответов.

В общем-то, все так и есть.

Хотелось бы немного осветить эту тему еще разок.

1) ESX

ESX устанавливать с файлом ответов можно было всегда – и это не сложно.

Начиная с 4.0 файл ответов со значениями по умолчанию входит прямо в дистрибутив, см. esx kickstart file.

Притом такой файл ответов может быть весьма мощным - Автоматическая установка ESX.

Наконец, можно устанавливать по старинке или с дефолтным файлом ответов, а автоматизировать последующую настройку - Автоматическая массовая настройка ESX.

2) ESXi

Не сразу, но появилась возможность устанавливать с файлом ответов - ESXi kickstart file.

Потом был описан способ добавить файл ответов в дистрибутив - esxi kickstart.

Только что мне попался очень, очень толковый список полезного про файл ответа для установки ESXi - Automating ESXi 4.1 Kickstart Tips & Tricks.

Так же не забываем о возможности записать дефолтный образ ESXi на флешку из под компьютера с Windows\Linux - Создание загрузочной флешки с ESX 3i. (этот пост за январь 2008 до сих входит в четверку популярнейших с точки зрения blogger, я удивлен).

Запустить ESXi c этой флешки в виртуальной машине и настроить его заранее поможет VMware Workstation VM USB boot.

Дополнительно

Для отладки этого дела может быть очень полезен готовый сервер дистанционной установки, с поддержкой ESX(i) из коробки - Ultimate Deployment Appliance. (к первой версии этого отличного средства я когда-то накатал русскоязычную инструкцию)

Ну и напомню, что у VMware появился продукт для сетевой даже не установки, а загрузки ESXi с последующей автоматической настройкой - Auto Deploy.

_

fstec + vSphere

Какое-то время назад компания VMware объявила о получении сертификата ФСТЭК России.

Правда, у меня в комментариях есть разные мнения про этот документ.

А сейчас Ещё раз про сертификат ФСТЭК и vSphere.

После публикации новости о получении сертификата мы стали получать довольно много просьб выложить сканы сертификата и ТУ. Сканы документов вы можете увидеть и скачать ниже. Еще хочется ответить на самый популярный вопрос, который нам задают:

Вопрос: Как приобрести сертифицированную версию продукта?

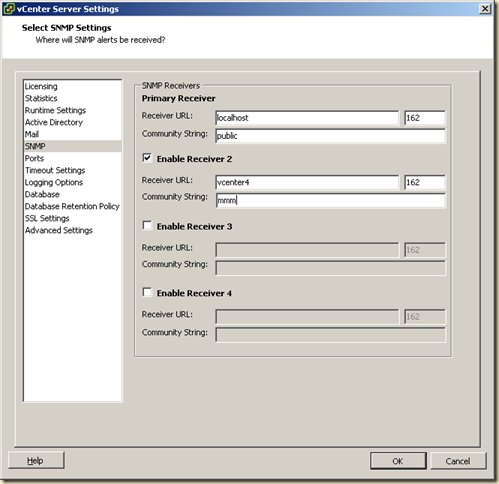

snmp

Для того, чтобы взаимодействовать с vSphere по SNMP, есть два пути.

Вариант 1.

Настроить alarm на vCenter, и в качестве реакции указать оповещение по SNMP.

Куда слать сообщения и с каким community – указываем в настройках vCenter.

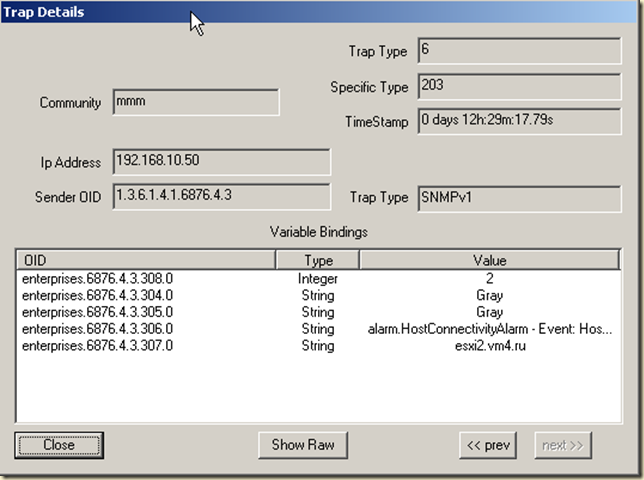

В результате – подобное оповещение, что ВМ потребляет аж больше 77% памяти:

Или что сервер отвалился от vCenter:

Ну и куча всего другого, из того что могу отслеживать alarm. Ну то есть все что угодно. Подробнее см. в доке и тут - vSphere alarm triggers.

Вариант 2.

Настроить SNMP на самих серверах ESX(i).Как это сделать, толково описано, вы удивитесь, в документации.

Вкратце. Нет, не вкратце, а все три команды из доки:

Нам потребуются vSphere CLI. У меня есть vMA, на нее я и залогинился.

Кстати, кто с vMA ранее не сталкивался, можно глянуть, например, сюда - How to use vMA 4.1 installation, configuration.

А еще можно глянуть инструкцию как то же самое сделать без помощи vMA - Setup SNMP on vSphere ESX Host without vMA.

Итак, команды:

1) для добавления нужного коммьюнити

vicfg-snmp --server <имя хоста> –c <нужное коммьюнити>

например

vicfg-snmp --server esxi2 -c mmm

2) для указания адреса для отсылки trap сообщений

vicfg-snmp --server <имя хоста> –е <адрес:порт если не дефолтный\коммьюнити>

например

vicfg-snmp --server esxi2 -t vcenter4/mmm

2.а) если надо еще и get\set, то командой

vicfg-snmp --server <имя хоста> –p <порт>

указываем порт, который snmp агент будет слушать

3) включаем агента snmp

vicfg-snmp --server <имя хоста> –-enable

Все.

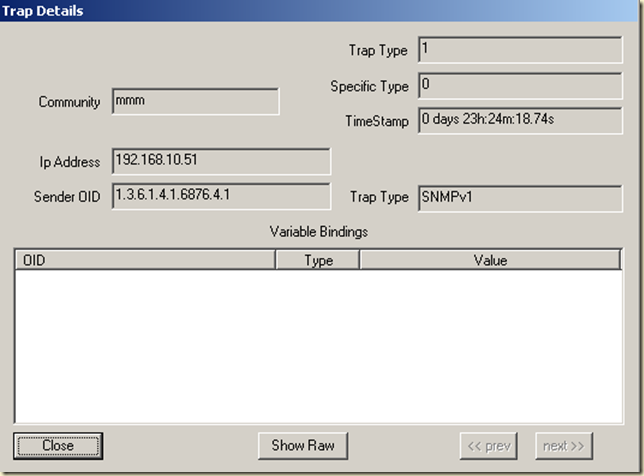

Теперь можно заслать тестовый trap:

vicfg-snmp --server <имя хоста> –-test

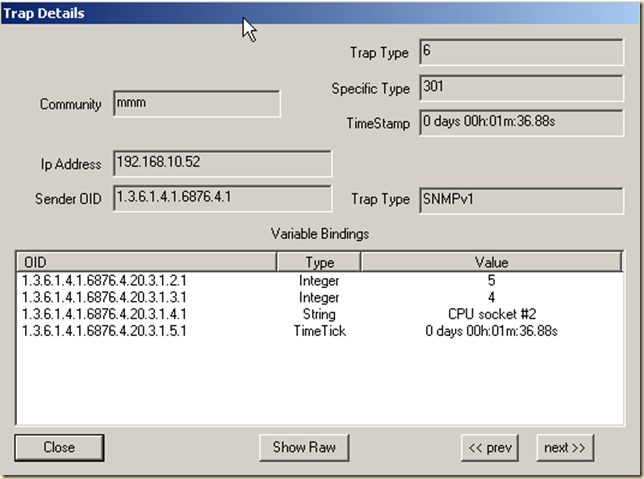

Итог: пойманный тестовый трап.

если раскрыть

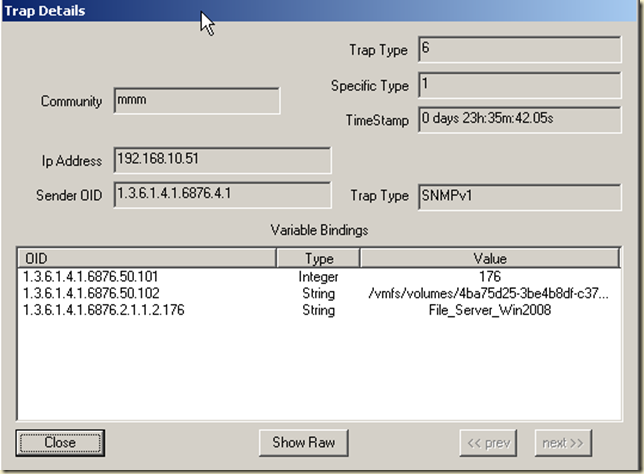

Штатный trap при включении ВМ:

Проблемы с железом ESX(i) будут отслеживаться, например что-то не то со вторым сокетом:

MIB библиотеки доступны для загрузки тут - http://communities.vmware.com/community/developer/managementapi.

Несколько видео

Для тех, кому нравится смотреть видео (я, например, с трудом это делаю – очень раздражает всегда неподходящий темп изложения, я лучше почитаю).

Так вот, пара видео на интересные темы:

Работа с памятью - Don’t use memory limits – Proofpudding.

Don’t use memory limits – Proofpudding from Eric Sloof NTPRO.NL on Vimeo.

Балансировка нагрузки для сети – Video - Load-Based Teaming (LBT) in action.

Load-Based Teaming (LBT) in action from Eric Sloof NTPRO.NL on Vimeo.

20 самых важных счетчиков производительности – The Top 20 VMware Performance Metrics You Should Know About.

Network I/O Control, NIOC

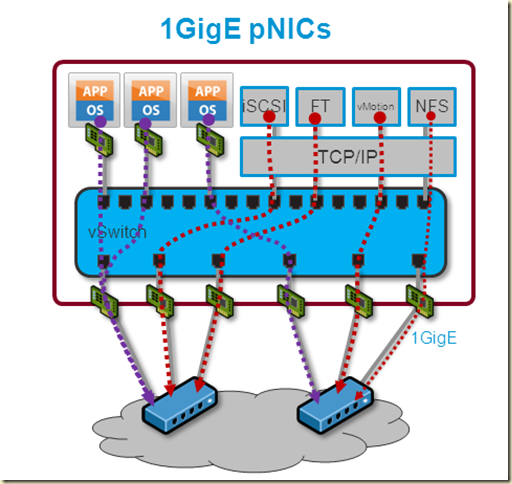

Сегодня у большинства из вас сетевая часть инфраструктуры выглядит примерно так:

Т.е. сколько-то гигабитных портов, как-то разделенных между источниками трафика.

Однако будущее выглядит как-то вот так:

Т.е. пара десятигигабитных портов на все про все.

Но тут есть опасность – всплеск чего-то одного может помешать все остальным. Например, запустили пару VMotion – просел iSCSI.

У vSphere есть средство борьбы с этим, и называется оно Network I/O Control, NIOC.

Я к чему это – VMware опубликовала документ с нюансами - VMware® Network I/O Control: Architecture, Performance and Best Practices.

суббота, 2 октября 2010 г.

VMware Workstation VM USB boot

Понадобилось мне сделать сделать загрузочную флешку. Конкретно в этот раз я захотел сделать загрузочную флешку из DrWeb LiveCD – это штатная фича.

Для этого требуется загрузится с этого LiveCD и нажать иконку создания загрузочного USB.

Очевидно, что сделать это естественней всего в виртуалке под Workstation, и проблем с этим нет.

А проблемы начинаются тогда, когда свежесозданную флешку хочется проверить. БИОС виртуалок VMware не умеет загружаться с USB устройств. Неприятно, и неудобно.

Но я помнил, что то ли я где-то читал, то ли мне кто-то говорил про решение этой проблемы, и гугл в очередной раз выручил.

Берем вот такой архив - Plop Boot Manager, загружаем, распаковываем.

Загружаем виртуалку с plpbt.iso из архива, и видим радующее нам меню:

Загрузка виртуальной машины VMware Workstation с USB отлично работает с использованием этого промежуточного средства.

Можно, например, ESXi с флешки в ВМ загружать так.

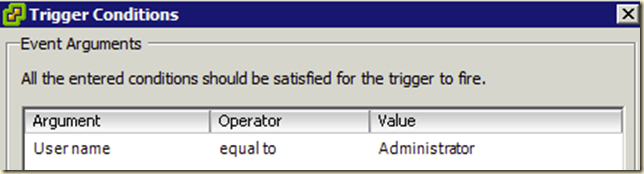

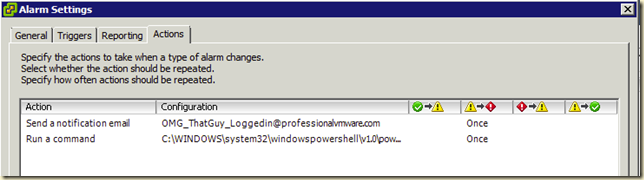

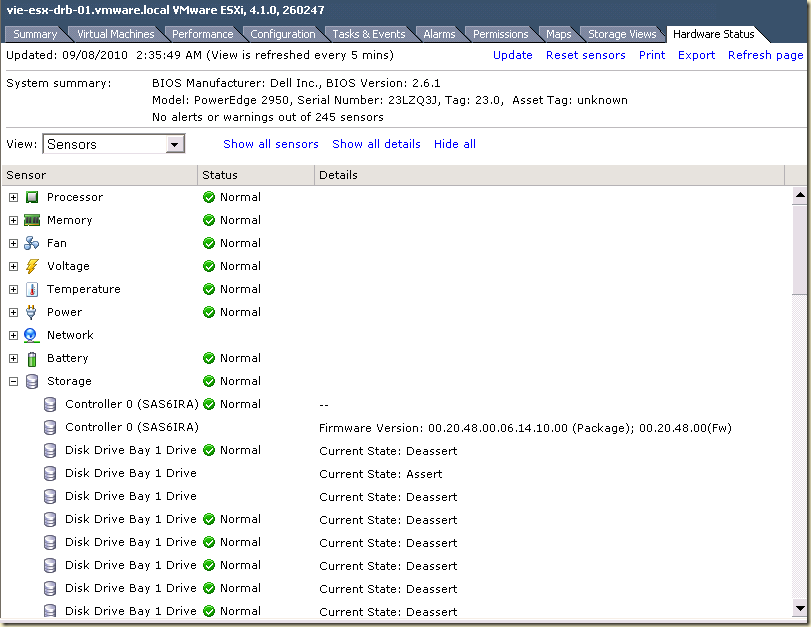

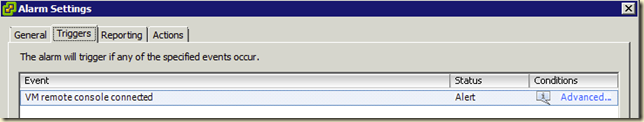

alarm + response

Иллюстрация интересной конструкции, задействующей сразу несколько возможностей вСферы - Protecting your Virtual Machines From “That Guy”.

Итак, поставлена задача – отреагировать на такое событие, как открытие консоли к ВМ из под учетной записи Administrator. В оригинале – сделать снимок состояния этой ВМ.

Конкретно такая задача, наверное, малоинтересна, но как просто иллюстрация сойдет.

Так вот, фишка номер раз – механизм alarm в vCenter способен отслеживать не только показания счетчиков, но и события, :

притом с условиям:

Ну и реагировать. Такие реакции как оповещение по SNMP, email и запуск произвольного скрипта доступны для любых alarm:

Обратите внимание, что на вход такому скрипту могут быть переданы переменные, их список доступен в документации.

В первоисточнике немного больше подробностей конкретно про решение упомянутой вначале задачи, с примерами скриптов.

новости от Citrix

Citrix выпускает бета версию XenServer - XenServer Project "Cowley" Beta Now Available.

Читаешь список нового, и думаешь – “Фигасе сколько всякого у них не было раньше. А все туда же, сравнения выпускали.”

Плюс к тому – еще и XenClient 1.0 Released.

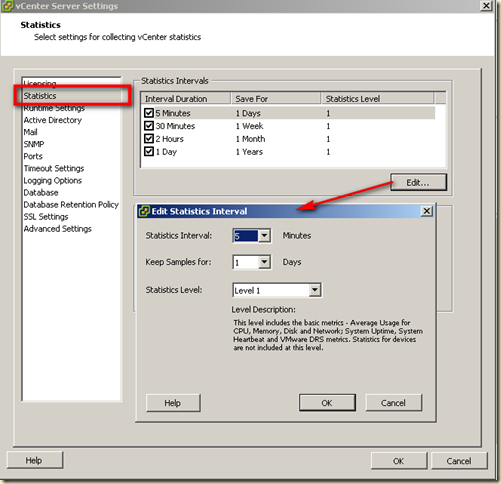

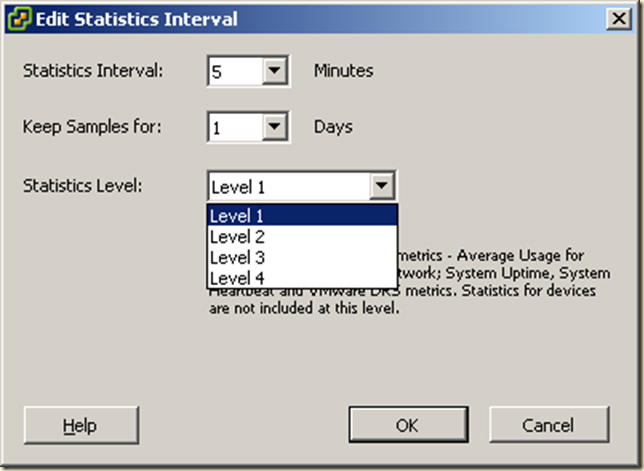

vCenter Statistic level, VC StatLevelConfig

Если обратиться к настройкам vCenter

то среди них можно обнаружить настройки логирования:

Копнув чуть глубже, можно увидеть что есть четыре уровня сбора статистики:

Их отличия:

По умолчанию собирается минимум информации. А что делать, если хочется больше?

Повышать уровень логирования.

А чем это плохо?

Тем, что база vCenter начинает расти значительно быстрее.

Так что делать?

Если мы четко знаем что мы хотим, то с помощью экспериментальной утилиты VC StatLevelConfig можно добавить отдельные счетчики в тот или иной уровень логирования.

В одном месте написано что работает только с vCenter 4.1, в другом — что и с 4.0 тоже.

View 4.5

Коллеги, не так давно VMware выпустила довольно значительное обновление своего продукта для организации виртуальных рабочих мест, VDI.

Это VMware View версии 4.5 — страница продукта.

Официальный форум.

Вся документация, моя любимая онлайн ее версия.

Мой вариант простейшей настройки — View 4.5 how-to.

Самопальный калькулятор — VDI Calculator.

Обзор

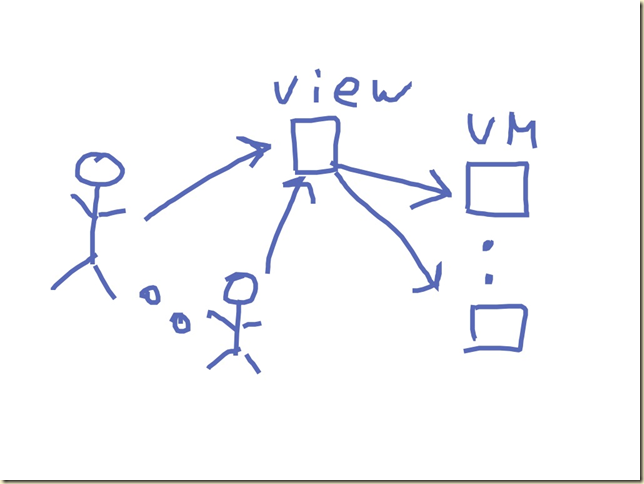

Пару слов о чем речь.Для новичков:

Очень вкратце: берем кучу юзеров, и создаем им рабочие места не в виде писюков под столом, а в виде виртуальных машин. View в этой схеме занимает место сервера управления этой инфраструктурой. Создает ВМ из шаблонов, назначает ВМ пользователю, принимает подключения от пользователей и перенаправляет их на нужные ВМ. Работает VMware View поверх VMware vSphere.

Такая схема, называется она VDI, приносит примерно тот же профит, что и терминальные сервера — но есть случаи, когда терминалы не применимы, а VDI — вполне.

Обзор нового относительно предыдущей версии

Для тех, кто в курсе что такое View, на примере предыдущих релизов, вот информация по тому, что там нового:- новый клевый интерфейс, и нормальная система статусных сообщений

- поддержка vSphere 4.1

- Windows 7 Support 32/64-Bit

- Smart Card Support for PCoIP

- Local Mode Desktop — бывший offline desktop. Это когда юзер может выгрузить ВМ на свой ноутбук, и работать в ВМ без доступа к сети. После возвращения в сеть ВМ возвращается на vSphere

- A native Mac Client — родной клиент под MAC

- Kiosk Mode — возможность настроить клиентское устройство без участия пользователя,

вообще юзеру на локальном девайсе ничего делать не надо будет. - Automated USB Redirection

- Location based printing

- Client localization (German, Japanese, French, Simple Chinese) — кстати, можно почитать вот тут — VMware View Client на русском

- Role based delegation — мощная система распределения прав

- Persistent disk и Disposable Disk — появилась возможность автоматически создавать временные диски под файлы подкачки и т.п., ну и остались старые добрые UDD

- Tiered storage support — один Linked Clone состоит из нескольких дисков (см. предыдущий пункт). Какой-то — системный, где-то — пользовательские данные, на следующем — всякая фигня. Так вот, разные диски можно автоматически располагать на разных хранилищах, максимально подходящих по ту или иную задачу

- Refresh, Recompose and storage rebalance for non-persistent pools

- Semi-automatic pools

- Extensibility with Powershell, SCOM and SDK’s

- System Dashboard, User diagnostics and troubleshooting

- ThinApp entitlement — началась, наконец-то, интеграция доставки ThinApp пакаджей на виртуальные десктопы View. Немного подробностей тут - VMware View 4.5 Application Assignment explained & tips.

- Smart Card revocation

View Client with Offline Desktop —> View Client with Local Mode

User Data Disk —> Persistent Disk

Persistent Desktop pool —> Dedicated Desktop pool

Non-persistent Desktop pool —> Floating Desktop pool

Некоторые цифры:

— View 4.5 поддерживает

— С точки зрения сети речь идет о порядка

— Но лучше бы иметь возможность обеспечить 0.5 — 1 Мбит/с под всплески перерисовки экрана;

— Если юзерам охота смотреть видео, то для 480p нужно порядка 1 Мбит/с ;

Пара замечаний про обновление View 4.0 —> 4.5

Официальная дока — Upgrade Guide.Неофициальная — How to: Upgrade to VMware View 4.5.

Если использовались Linked Clones вместе с User Data Disk, то при штатном обновлении View 4.5 затирает эти UDD. Как можно этого избежать, пусть и не очень красиво — Upgrading to View 4.5 with existing user-data disk issue.

Как начать получать профит — программу минимум я постарался рассказать в предыдущем посте — Настройка View 4.5.

Те из вас, кто овладел нелегким исскуством читать документацию до того, как что-то делать, нового найдет немного, но как инструкция «на попробовать» на русском языке — сойдет.

Про Linked Clones

Вот тут — VMware View 4.5 Linked Cloning explained — сообщают подробности о новшествах связанных клонов в View 4.5.Вкратце:

Раньше мастер-образ (ВМ с именем replica) создавался на каждом хранилище, где могли быть расположены связанные клоны. Сейчас — только на одном.

Один связанный клон может иметь до 4х дисков:

Системный, состоящий из общего мастер-образа и уникальной дельты.

Диск с профилем пользователя — Persistent disk.

Диск с файлом подкачки и каталогом temp — Disposable Disk

Диск с файлами конфигурации для QuickPrep.

Короче — все стало лучше чем раньше.

Особенно по той причине, что View может сам диски с разными задачами располагать на хранилищах с разными характеристиками.

А вот тут — Hosting 20 linked clones on SSD storage — рассказывается про запуск 20 связанных клонов на одном SSD диске. Правда, когда я читал эту заметку, картинки с графиками не грузились :(

View 4.5 how-to

Введение

Для того, чтобы начать пользоваться VMware View, вам еще потребуется:

- Развернутая vSphere (т.е. vCenter и хотя бы один сервер ESX(i)).

- Домен Active Directory, DNS и DHCP.

Развертывание этих компонентов остается за кадром. Описанные здесь действия подразумевают, что у вас уже есть vSphere, AD, DNS, DHCP. Также вам необходим сервер(обычно ВМ) под View - это Windows 2003\2008, и эта Windows должна быть введена в AD. vCenter в AD можно не вводить - для View это не играет роли. Желательно иметь выделенную ВМ под View - на vCenter и контроллер домена View устанавливать нельзя, с другими приложениями возможны конфликты.

Инструкция писалась по версии 4.5, но для 4.6 годится в полный рост. Самое заметное отличие 4.6 - возможность туннелирования PCoIP трафика. Для этого Conection или Security сервер View обязан быть установлен на Windows 2008 R2.

Что еще может быть полезным для вас:

- VMware View — страница продукта.

- Официальный форум.

- Вся документация, моя любимая онлайн ее версия.

- pdf версия буржуйской книги Administering VMware View 4.5.

- Утилита, генерирующая пользовательскую нагрузку и замеряющая время реакции - vdi-sizing.com.

- ZeroClient и VMware View - что такое ZeroClient, пример настройки, интересные комментарии.

- Ubuntu linux + VMware View PCoIP - linux версия клиента View с поддержкой правильного протокола.

- Ericom HTML5 Client for VMware View - HTML версия клиента View.

- PCoIP Server Offload Card - решения для увеличения производительности PCoIP на стороне сервера.

- SSL certificates in VMware View environments.

- vSphere Security - некоторые компании (читай TrendMicro) уже продают решения, которые позволяют повысить безопасность виртуальной инфраструктуры используя ее спецвозможности для этого.

- TPS vs. Large Pages in real life - способ попробовать значительно снизить потребление памяти в vSphere.

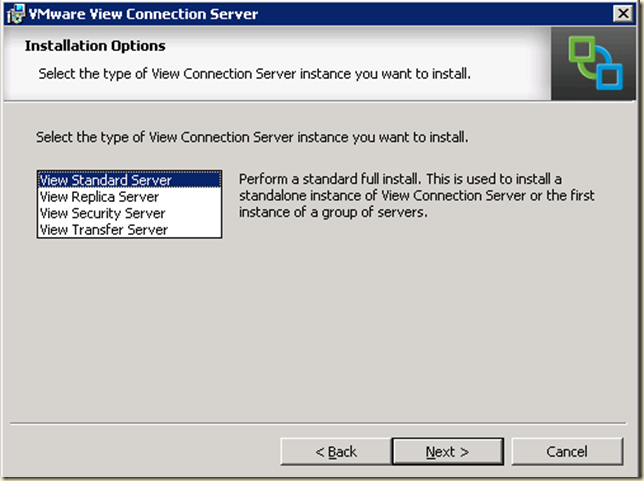

1. Установка и базовая настройка View connection server

В этом разделе несколько слов про установку и базовую настройку View Connection Server.1.1 Установка

Мы посмотрели в документ VMware View Integration Guide, выполнили необходимые подготовительные шаги.Это:

· Создание OU для виртуальных десктопов и (если будут использоваться) связанных клонов;

· Настройка restricted groups (надо ли если только PCOIP?);

· Создание учетных записей для view server и, если надо, composer. Их создаем в AD, даем необходимые права в vCenter.

Теперь запускаем установку- vmware-viewconnectionserver-4.5.0-293049.exe

Рисунок 1‑1

Выбираем установку Standart Server. Next, Next, Finish.

Есть возможность установить без вопросов, скормив установщику несколько параметров (в документации стр. 40).

Используются кое-какие порты, они должны быть открыты в брандмауэре.

1.2 Базовая настройка

Интерфейс управления доступен при обращении браузером по адресуhttps://viewserver/admin/

после авторизации учетной записью, имеющей права локального администратора в Windows сервера View.

Минимальными настройками являются указание лицензии и добавление информации о vCenter сервере (серверах, если вдруг один View работает с несколькими серверами vCenter).

Рисунок 1‑2

1.3 Создание базы данных событий

На сервере баз данных следует создать базу для хранения событий View.(Это не обязательно для работы, но крайне желательно на случай каких проблем - без нее сложнее будет разобраться)Например, создадим базу для БД SQL Express, которая используется на сервере vCenter.

Загрузите и установите консоль SQL Server Management Studio Express (для SQL Express 2008 r2). Запустите консоль, вызовите контекстное меню для сервера и зайдите в свойства.

В пункте Security выберите SQL Server and Windows Authentication mode.

Рисунок 1‑3

Затем вызовите контекстное меню для пункта Databases и выберите New Database. Укажите имя для создаваемой базы, например ViewEvens.

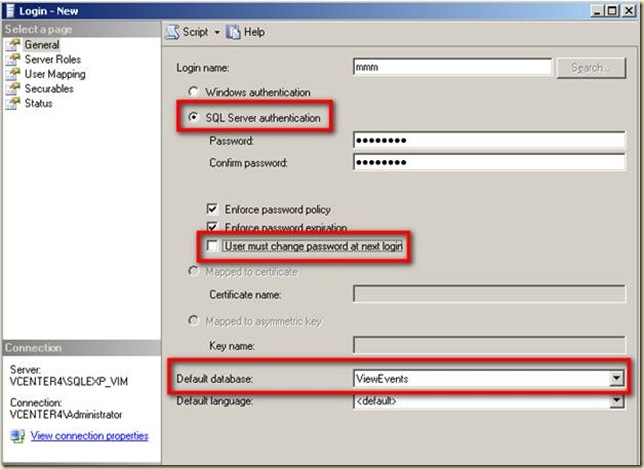

Затем, в консоли SQL Server Management Studio Express пройдите Security -&amp;gt; Logins -&amp;gt; New Login.

Рисунок 1‑4

(У меня по какой-то причине эта настройка Windows | SQL Server authentication вернулась в значение по умолчанию, так что если у вас не будет получаться — ещё раз ее проверьте.)

Затем выберите пункт User Mapping и укажите как на рисунке:

Рисунок 1‑5

Одним из параметров для дальнейшей настройки является порт, по которому будет идти обращение. Для SQL Express его следует уточнить, запустив оснастку SQL Server Configuration Manager на сервере БД (здесь у меня — на сервере vCenter).

Рисунок 1‑6

Теперь в интерфейсе View укажем параметры для использования этой базы. Нас интересует пункт настроек View Configuration &amp;gt; Event Configuration &amp;gt; Edit. Указываем параметры доступа к созданной ранее базе данных.

Рисунок 1‑7

Для проверки корректной работы системы статусных сообщений, перейдите в раздел Monitoring &amp;gt; Events, в нем вы должны увидеть статус объектов и сообщения.

2. Создание виртуальной машины — основы виртуального десктопа View

Используя интерфейс клиента vSphere, создайте виртуальную машину и установите в качестве гостевой ОС десктопную версию Windows. Есть небольшой нюанс — для десктопной Windows в качестве виртуального SCSI контроллера лучше бы выбрать LSI Logic. А чтобы установщик Windows его увидел — необходимо скачать и подсунуть flp образ с соответствующим драйвером. Этот flp можно найти на vmware.com или на lsi logic.com — вам нужен драйвер для контроллера LSI20320-R. Я пользуюсь вот этим образом — http://download3.vmware.com/software/vmscsi-1.2.0.4.flp.Теоретически, начиная с 4.1 для WinXP можно использовать паравиртуализованный SCSI контроллер, образ с драйвером которого поставляется в составе ESX(i). Но вроде бы VMware рекомендует использовать PVSCSI только для ВМ с интенсивной дисковой нагрузкой.

Эта виртуальная машина может быть сразу настроена как виртуальный десктоп с точки зрения View — тогда выполняем настройки и установку ПО в зависимости от пользователя, который с этой ВМ будет работать.

Или эта виртуальная машина будет основной, шаблоном, для развертывания многих однотипных ВМ — с точки зрения View это будет пул виртуальных десктопов.

Параметры виртуальной машины, настройки гостевой ОС, набор установленного ПО зависит только от задач, которые вы возлагаете на виртуальные десктопы, за редким исключением.

Типовыми настройками являются:

· установка VMware tools;

· установка обновлений для Windows и ПО;

· установка антивируса;

· настройка IP (статика или DHCP), и ввод виртуальной машины в домен AD

(если ВМ будет использоваться как основа для связанных клонов — в AD вводить не надо);

· настройки оформления на наилучшее быстродействие, отключение обоев, отключение скринсейверов (кстати, ткните меня носом — как это сделать для юзера ДО того, как им залогиниться и вручную все отключить. Групповые политики?);

· отключение выключения экрана и отключения дисков при неактивности;

· отключение службы индексирования дисков;

· запуск Windows Media Player и применение настроек по умолчанию;

· открытие портов в брандмауэре, например для RDP (если RDP планируется к использованию);

· (возможно) включение доменной группы будущих пользователей в группу локальных администраторов;

· обязательно необходимо установить агент VMware View.

Если мы планируем виртуальную машину использовать как виртуальный десктоп, то на этом все — теперь идем в настройки View.

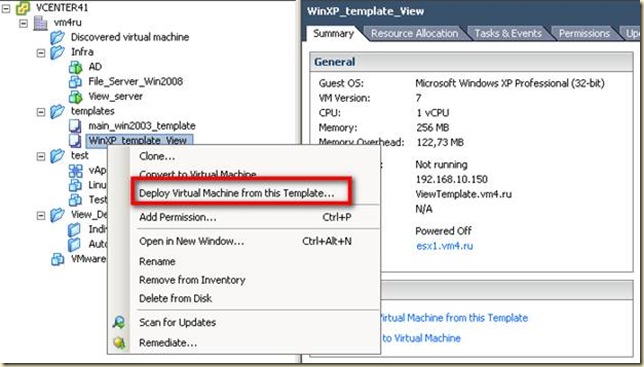

Если данная ВМ — эталон для будущего пула виртуальных десктопов, то необходимо ее выключить, преобразовать в шаблон, и из шаблона один раз развернуть новую ВМ. Это разворачивание преследует две цели:

1. Убедиться, что развернутая из шаблона ВМ удовлетворяет нашим требованиям, и все настройки мы сделали корректно.

2. Сохранить файл ответов для обезличивания в vCenter — View в дальнейшем будет использовать этот файл для автоматического развертывания новых ВМ.

Вот по второму пункту слегка подробнее.

Напомню, что для обезличивания и разворачиваемых из щаблона ВМ vCenter использует утилиту sysprep. Если гостевой ОС у нас с вами является Windows Vista или Windows 7, то sysprep уже предустановлен в этих ОС. А если, как у меня, WinXP, то sysprep следует отдельно загрузить и сделать доступным vCenter. Удобнее всего ознакомиться с тематической статьей базы знаний VMware — http://kb.vmware.com/kb/1005593. В ней есть и прямые ссылки на sysprep для разных версий ОС Windows, и указание куда его следует скопировать на сервере vCenter (на Windows 2003 и 2008 пути слегка отличаются).

Итак, развертываем тестовую ВМ.

Рисунок 2‑1

Внимание, анимированный gif:

Рисунок 2‑2

3. Настройка виртуального десктопа в View.

Дальнейшие настройки делаются на сервере View. Следует авторизоваться, и перейти к пункту настроек Inventory &amp;gt; Pools.

Рисунок 3‑1

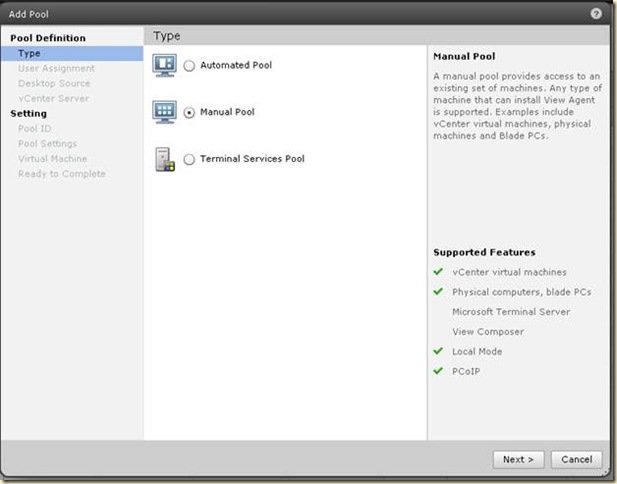

3.1 Отдельная ВМ

Если нам необходим статичный набор из одной или более ВМ, то запустив мастер добавления пула, выбираем Manual Pool.

Рисунок 3‑2

Затем нас спрашивают будут ли ВМ жестко привязаны каждая к одному юзеру, или «кто первый встал того и тапки»:

Рисунок 3‑3

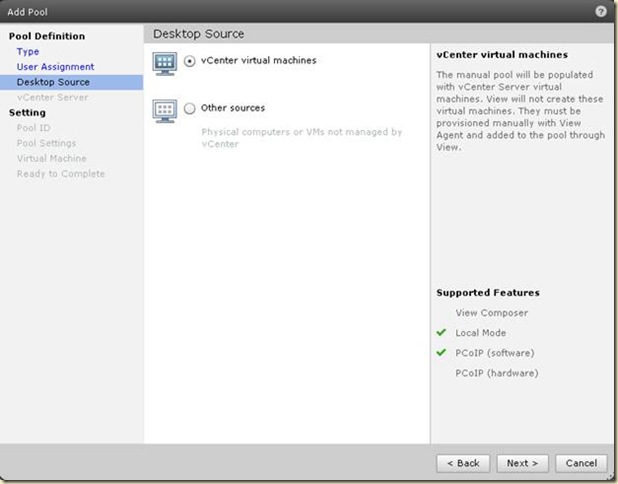

Этот пул десктопов View может ссылаться не только на виртуальные машины vCenter (что сейчас надо нам), но и на ВМ не с vSphere, и на физические машины:

Рисунок 3‑4

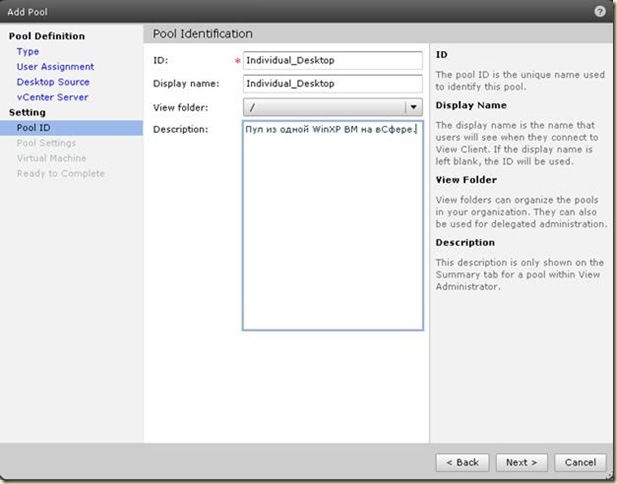

Указываем внутреннее имя и отображаемую пользователям метку:

Рисунок 3‑5

Настройки пула сейчас оставляем по умолчанию:

Рисунок 3‑6

На этом шаге View покажет нам список ВМ с десктопными ОС и View Agent внутри. Из списка вы выберем те, которые должны входить в создаваемый пул. Выбор сейчас небогатый:

Рисунок 3‑7

Следующий шаг — назначение группы пользователей из AD, кому будет доступна возможность подключаться к данному пулу при обращении на View Server. Пройдите Inventory &amp;gt; Pools &amp;gt; выберите созданный пул &amp;gt; Entitlements.

Рисунок 3‑8

Нажав эту кнопку, укажите нужную группу\пользователя.

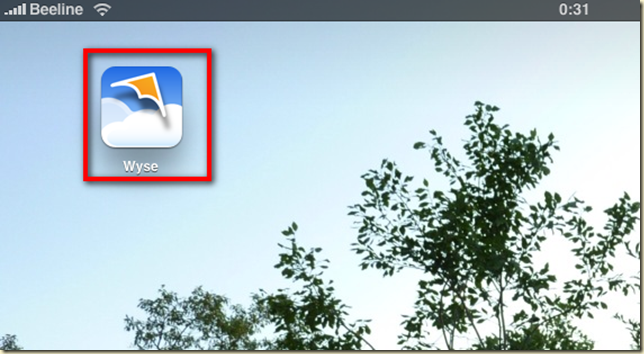

3.1.1 Проверка подключения к этой ВМ, например с iPad

(В общем-то, этот пункт я добавил только для того, чтобы похвастаться моей гламурной игрушкой :-))Запускаем нужный клиент:

UPD. Появились родные клиенты под iPad и Android.

Рисунок 3‑9

Выбираем нужный тип подключения:

Рисунок 3‑10

Указываем параметры подключения:

Рисунок 3‑11

Притом домен и доступные (тут — единственный доступный) пулы клиент подсказывает самостоятельно.

И, в общем-то, все:

Рисунок 3‑12

Рисунок 3‑13

3.2 Автоматический пул

Для создания автоматического пула View действия требуются тоже несложные.Запускаем мастер создания пула, указываем что он автоматический. Затем все просто:

Рисунок 3‑14

Рисунок 3‑15

Рисунок 3‑16

Рисунок 3‑17

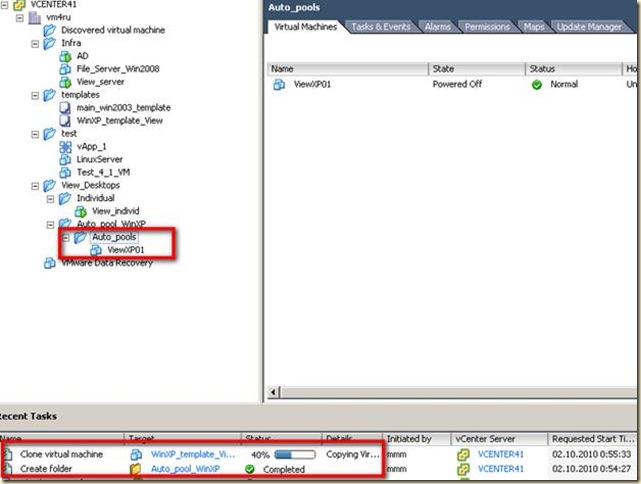

Обратите внимание — при моих настройках развертывания (держать одну ВМ наготове, Spare), в vCenter начинается развертывание ВМ:

Рисунок 3‑18

Напоследок, выполните назначение группы для этого пула — Entitlement. А затем — подключайтесь. Например, теперь поговорим про стандартный способ — клиент View.

4. Установка клиента View

Установка клиента View не представляет из себя ни чего-то сложного, ни интересного. Демонстрировать я буду Windows версию клиента — Сетап екзе, некст некст, ентер.После запуска установленного клиента указываем сервер View для подключения, и авторизуемся.

Рисунок 4‑1

Кстати, как сделать так, чтобы в выпадающем меню заранее было несколько нужных нам вариантов vew серверов - VMware View Client DropDown Menu Automation.

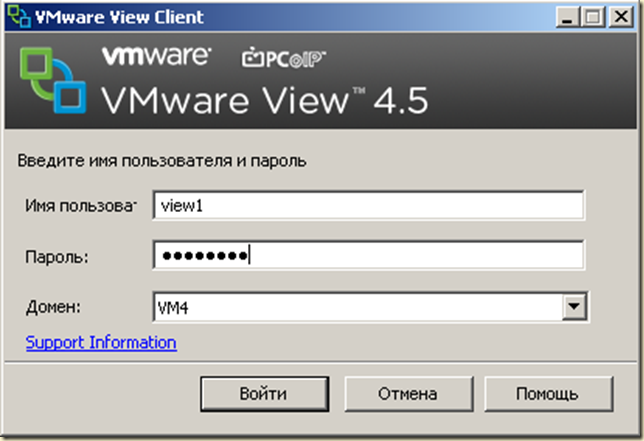

Указываем пользователя:

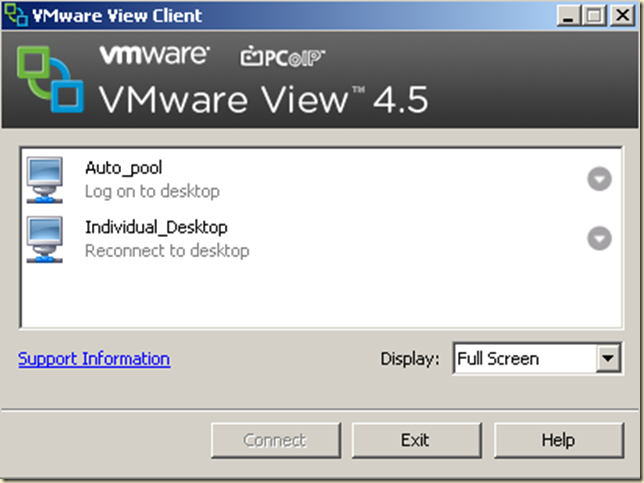

Затем выбираем требующийся из доступных указанному пользователю пулов View:

Рисунок 4‑2

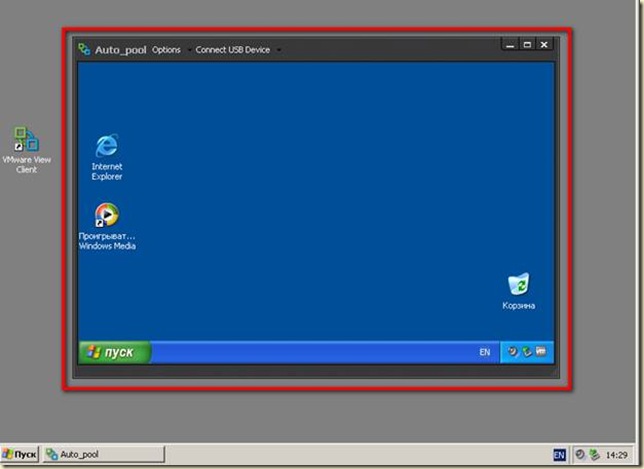

И, в общем-то, все.

Рисунок 4‑3

5. Создание пула связанных клонов, Linked Clones

Для того, чтобы создать такую хитрую группу ВМ, требуется установить продукт View Composer на сервер vCenter, а затем создать соответствующий пул виртуальных десктопов во View.5.1 Установка View Composer

Для начала требуется создать базу для Composer, затем ODBC коннектор к ней, и затем уже устанавливать сам Composer.5.1.1 Настройка БД

Создание базы и коннектора весьма просты. Я приведу самый самый простой вариант — когда Composer использует тот же SQL Express, что и vCenter.Запустите SQL Server Management Studio Express, правый клик на Databases -&amp;gt; Create New.

Укажите название, все остальное по умолчанию.

Затем запустите Administrative tools -&amp;gt; Data Sources (ODBC), на вкладке System DNS создайте новый коннектор SQL Native Client, используя Windows Authentication. Не забудьте указать использование по умолчанию базы, созданной чуть ранее.

5.1.2 Установка Composer, настройка Composer для View Connection Server

Запустите установку. На шаге Database Information введите имя ODBC коннектора, имя пользователя и пароль оставьте пустыми/ Правда, в доке написано, что здесь следует указать учетку доменного администратора, имейте в виду.Все.

После завершения установки вернитесь в интерфейс администрирования View.

Зайдите в свойства vCenter, поставьте флажок Composer:

Рисунок 5‑1

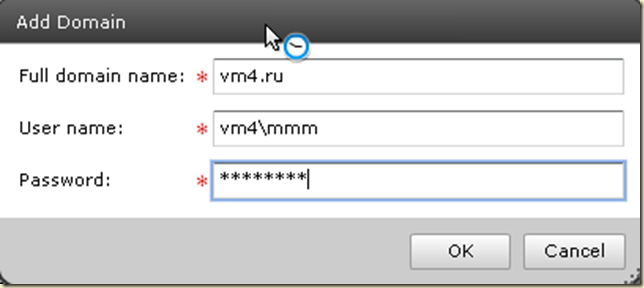

Нажмите Add, и укажите доменного пользователя, который затем будет использоваться для ввода в домен связанных клонов.

Рисунок 5‑2

5.2 Подготовка виртуальной машины — основы для связанных клонов

Данная виртуальная машина подготавливается практически так-же, как и ВМ для простых пулов, однако существует пара нюансов:1. Эта ВМ не должна входить в домен AD, а должна являться частью рабочей группы WORKGROUP.

2. После завершения всех настроек ВМ следует выключить, и создать снапшот.

5.3 Настройка пула связанных клонов во View

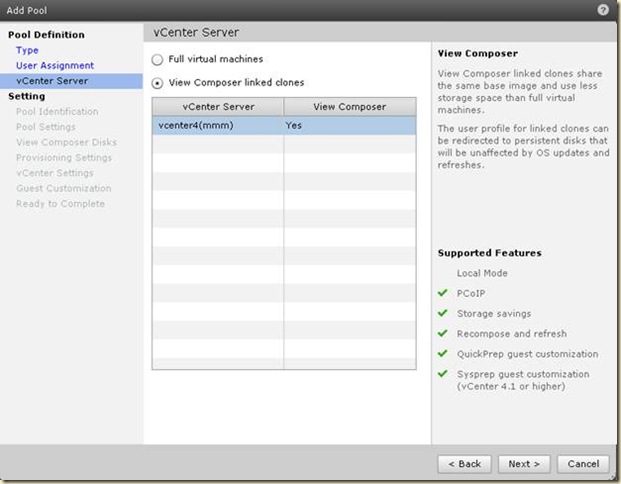

В интерфейсе View создаем автоматический пул, на шаге vCenter Server указываем, что хотим использовать Composer Linked Clones.

Рисунок 5‑3

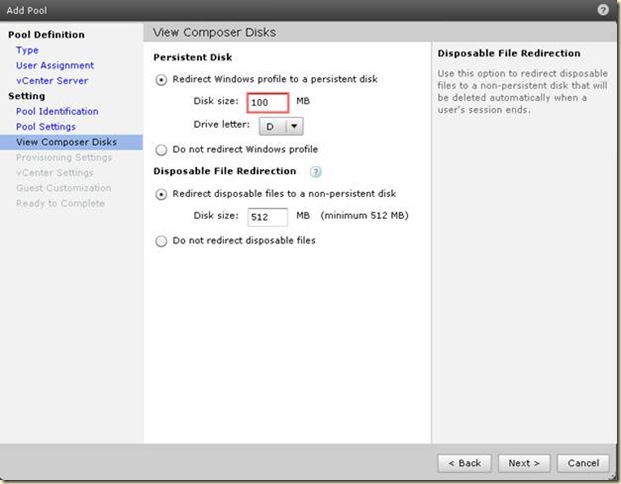

На шаге View Composer Disks можем указать использование

· Persistent Disk — это диск для хранения профиля пользователя, чтобы этот профиль не удалялся при очищении дельты системного диска связанного клона. Если вы создаете пул типа Floationg, т.е. без жесткого закрепления ВМ на пользователем, то создание диска для профиля по понятным причинам не предложат.

· Disposable File Redirection — временный диск для размещения файла подкачки и временных файлов гостя.

Рисунок 5‑4

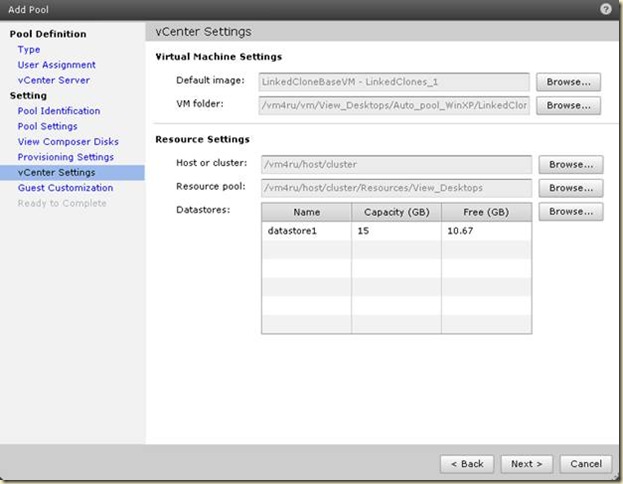

На шаге vCenter Settings требуется указать виртуальную машину, с которой будет создан мастер-образ связанных клонов, и где в иерархии vCenter связанные клоны будут создаваться.

Рисунок 5‑5

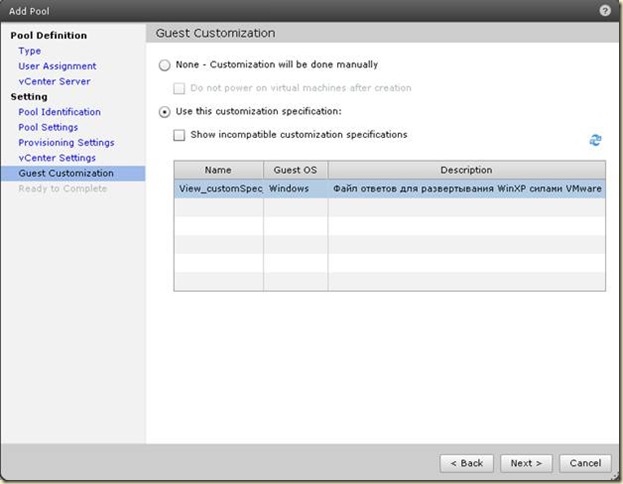

Guest Customization теперь умеет использовать не только QuickPrep, но и Sysprep для связанных клонов. Я пока еше не понял чем второй интереснее. Для простоты выберем QuickPrep — эта написанная программистами VMware утилита не будет изменять ничего, кроме имени ВМ, но ввод в домен обеспечит.

Все. После завершения мастера потребуется некоторое время, чтобы vCenter клонировал указанную выше ВМ — ведь мастер-образом, с которого будут загружаться связанные клоны, будет не указанная ВМ, а вот как раз ее клон. Вот так он выглядит с точки зрения vCenter:

Рисунок 5‑6

Затем будет создано минимальное число самих клонов — в соответствии с пунктом настроек пула Provisioning Settings. Каждый клон будет разок перезагружен — из за кастомизации QuickPrep|Sysprep.

Не забыв сначала сделать Entitlements, подключаемся:

Рисунок 5‑7

Конечно, о многом тут еще не рассказано. Я даже список не буду создавать — лень еще много букв писать :-)

Вместо этого я сообщу, что с конца ноября мы начнем читать курс по View версии 4.5. Это будет четырехдневный, очень интересный курс, велкам.